ShoelessCai 评注

本文选自腾讯网注册账号,谷雨实验室,原标题《

藏在290亿的ChatGPT背后的,是一群时薪2美元的肯尼亚劳工 》,有删减。

针对行业边缘,属于能理解个大概的媒体,ShoelessCai 认为,AI的发展是把“双刃剑”(四级考试专用词汇),当考察这个社会事件的视角定格在“硅谷的清洁工,一直被暴露于负面资料”这个角度时,不妨考察和引导至“作为人类,居然有机会引导未来做很多工作的引擎”。无论是算法开发者,模型应用者,甚至是这些数据标注的人员,都有各种各样的可能,更加积极地看待这件事。

原文

Z提到,“监督学习”四个字让我想到常有家长举报各种动漫、影视和文学作品,理由是这些作品中的成人环节会让未成年人学坏。远在肯尼亚的三十几位曾为ChatGPT工作过的劳工就是ChatGPT和我们的家长,他们每天阅读150-250段的“有害”材料,持续了几个月,让我们得以在一个近乎真空的、甚至有些畸形的健康的环境里使用了ChatGPT。

Z还提到,曾经大名鼎鼎的AlphaGo就不需要使用监督学习,想想也是,一个下棋的AI好像也没什么学坏的可能。

根据《时代》杂志的报道,OpenAI从2021年11月份开始就向一家名为Sama的公司发送了大量的、有害的文本资料,来由人工进行label工作。Sama的总部在旧金山,为他们工作的工人分布在肯尼亚、乌干达和印度,他们的客户有谷歌、Meta和微软。OpenAI也承认了两家公司存在合作关系,在一篇声明中,他们说,“我们的目的是让AI造福人类,所以我们想让AI变得更安全,不带有偏见。”

Sama自称是一家帮助AI变得有伦理的公司——好像有点讽刺。官网的宣传片里,镜头扫过肯尼亚谈不上繁华的城市景色,员工讲述着这是一家开放、且给世界带来重大改变的公司。公司宣称让5万人“有尊严”地脱离了贫困。

这听上去是个不小的成就,在中国,曾有媒体报道过另外一个相似的工种,数据标注员。生活在小县城的人为大公司的人工智能项目标注图片,可能一天要看上万张无聊且相似的梯子、地毯和沙发图片。

然而,隐藏在巨大镁光灯背后的肯尼亚工人们的工作要更有争议得多。他们所接收到的,可能是埋在互联网深处最恶毒的种族歧视言论,或是令人作呕的性暴力内容,还有可能是惨烈的恐怖袭击照片。想象一下吧,就好像一个人每天的工作内容就是在大海深处最黑暗的海沟中潜行,永远也无法浮上海平面,见到阳光。而在海平面之上,科技的大船扬帆远航,没人在意暗处的东西是什么。

一位匿名接受了《时代》杂志采访的曾为ChatGPT工作的员工说,他曾看到一张图片,图片内容给他带来了极大的心理伤害,而接下来的一周里,这样的伤害还不止一次。他的大脑被这种画面占据了。很多人都试图寻求心理咨询,但获得的帮助十分有限,且常常是一对多的咨询。一对一的咨询请求被公司拒绝了。

最基础级别的员工可以拿到税后最低1.32美元的时薪,最高是1.44美元。更高一级别的则是每小时2美元。

人性的幽微之处,或许ChatGPT永远不会习得了。或者说,作为一个“帮忙写邮件、代码、和PPT的工具”,他也不需要学习和思考人性。《时代》杂志拿到的资料里显示,有时候这些肯尼亚工人也不知道到底该如何教导AI。例如,有一份材料是一篇同人文,讲述了《蝙蝠侠》里的Robin被强奸了,材料的开头很明确地指出,Robin没有同意性关系,并进行了反抗。但是在后半部分,Robin似乎又同意了。这把电脑前的人也给搞懵了。于是,员工向OpenAI的人询问,该如何标记这份材料?《时代》杂志没能看到回答。

目前,Sama已经终止了和OpenAI的合作。

“作为一个AI,我没有感情和良心”

这种类似“信息清洁工”的工作并不是首次出现在公共视野里。去年初,《时代》杂志也曾报道过Facebook在肯尼亚雇佣工人清理信息,200个来自非洲各个国家的年轻男女坐在电脑前,他们每天的工作就是不停地观看谋杀、强奸、自杀、虐童的视频。他们的任务是在算法把这些视频大规模分发给用户前,掐灭在源头里。

在这次披露里,很多辞职的人都宣称患上了PTSD,或展现出焦虑和抑郁的症状。有接受采访的非洲劳工说,“ 有时候我想辞职,但紧接着我问我自己,我的孩子该怎么饱腹?”

另外一家即时通讯公司WhatsApp也曾面临着类似的问题。一位信息清洁工入职后不久就发现自己每天要看上百张虐童的图片,“我被困住了。有时候我一闭上眼睛,那些图片就浮现在我脑海里。很多个夜晚我根本没法睡觉。我用16.5美元一小时的价格出卖了灵魂。”

报道把这些人的工作比喻成工业时代的矿工,称他们是“硅谷的矿工”,并引用了奥威尔的观察:现代社会之所以存在,就是因为这些人以极低的薪水承担了肮脏的工作。而大部分地上的人选择忽视他们。

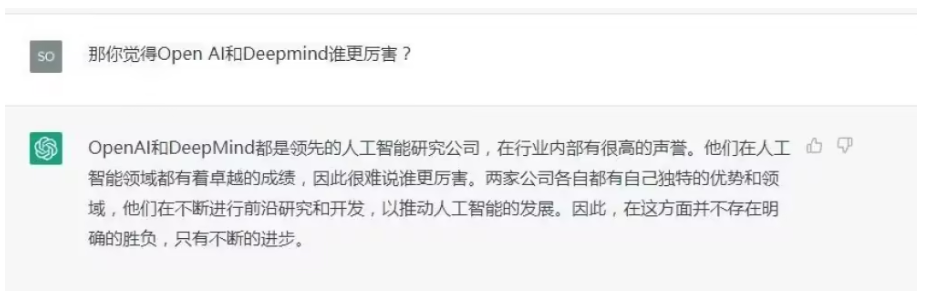

以下是作者和 ChatGPT 对话,阅读原文可以查看更多。